ACM MM2020 对抗性隐私保护滤波器

题目:Adversarial Privacy-preserving Filter

作者:Jiaming Zhang, Jitao Sang, Xian Zhao, Xiaowen Huang, Yanfeng Sun, Yongli Hu

1 摘要翻译

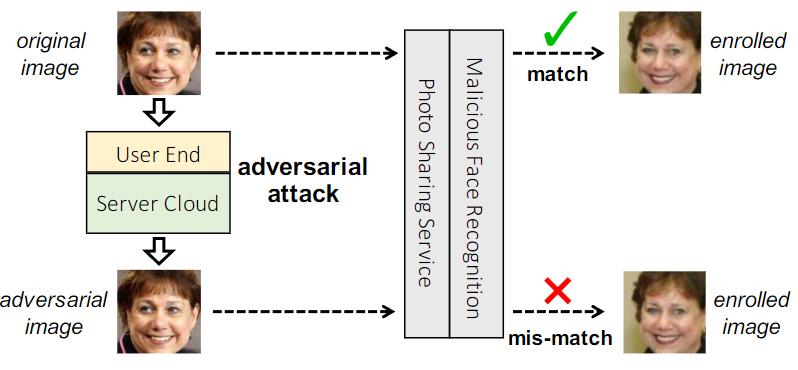

人脸识别在实际应用中得到了广泛的应用,在恶意使用人脸图像和潜在的隐私问题方面受到了广泛的讨论,例如欺骗支付系统和造成个人破坏。在线照片共享服务在无意中成为了恶意爬虫和人脸识别应用程序的主要存储库。这项工作旨在开发一种隐私保护解决方案,称为对抗性隐私保护滤波器(APF),以保护在线共享的人脸图像不被恶意使用。我们提出了一种端云协同对抗攻击解决方案,以满足隐私、实用和不可访问的要求。具体而言,该解决方案包括三个模块:(1)image-specific gradient generation,通过压缩探针模型提取用户端的image-specific梯度; (2)adversarial gradient transfer,对服务器云中的image-specific gradient进行微调; (3)universal adversarial perturbation enhancement,附加与图像无关的扰动来得到最终的对抗噪声。在三个数据集上的大量实验验证了该方法的有效性和高效性。还发布了一个原型应用程序,以供进一步评估。我们希望该端云协同攻击框架能够从用户端解决在线多媒体共享的隐私保护问题。

基本问题

- 解决的问题:生成保护隐私、实用、不可访问的人脸隐私保护掩码

2 Introduction

本文旨在在不影响用户分享照片体验的前提下,保护用户的肖像隐私。生成保护人脸隐私掩码需要考虑的要求:

- privacy. 用户的身份信息无法从向社交媒体共享的人脸图像中识别出来。

- utility. 面部图像的质量不能被破坏

对抗攻击能满足以上两点要求。虽然对抗样本可以保证照片在共享服务上的隐私保护,但在生成对抗样本时仍然存在隐私泄露的风险。由于大多数对抗攻击解决方案都涉及复杂的模型和大量的计算操作,通常都是将原始人脸图像上传到服务器进行处理。这不可避免地将原始人脸图像暴露给第三方应用程序,使它们在传输过程和云计算中都容易受到攻击。因此有第3个要求

- non-accessibility. 原始的人脸图像只能在用户端访问。

为解决以上3个要求,文章提出了一个端云协作的对抗攻击方法,其中原始人脸图像只用于提取image-specific gradient,接着在云服务端进行微调生成最终的对抗扰动。端云协同解决方案成功地解决了终端计算量不足与云中的隐私泄露风险之间的矛盾。此外,为了提高云中生成的对抗扰动的攻击性能,我们进一步引入与image-independent的通用对抗扰动进行增强,结果表明,该增强方法在加速训练收敛和增强攻击能力方面都是有效的。

文章贡献如下:

- 我们设计了一个对抗性隐私保护过滤器,在不影响用户的照片共享体验的情况下,保护用户的肖像隐私,免受恶意人脸识别破解者的攻击。对抗性攻击自然满足了隐私性和实用性两个基本要求。

- 我们提出了一个端云协作对抗攻击框架,该框架解决了额外的不可访问性要求,以保证原始图像只能被用户自己的设备端访问。这种两阶段攻击与传统的一阶段攻击的兼容性能也为理解对抗性攻击问题提供了一个新的视角。

- 我们将通用对抗扰动与image-dependent扰动相结合,以提高隐私保护能力。这提出了利用对抗样本的另一种方法。

- 我们进行了大量的实验,以验证所提出的解决方案框架的有效性和效率。进一步开发了一种对抗性隐私保护过滤器的原型,并发布进行评估。

3 Methodology

3.1 问题定义

给定原始图像\(x\),假设人脸识别模型是\(f_\theta\),生成\(l\)维的特征向量\(f_\theta(x)\)。且\(x_e\)表示对应的“注册图像”,当距离\(d(f_\theta(x), f_\theta(x_e))\)小于某个阈值时,就表明是相同身份,否则是不同身份。

本文的主要目的是生成不可见的对抗噪声\(s\),使对抗样本\(x+s\)与\(x\)在人类的视角下很像,但在人脸识别模型\(f_\theta\)下不是同一个身份。

3.2 总体框架

隐私保护过滤器的工作流程如Fig.2所示,包括用户端、隐私保护服务器云和照片共享服务三个部分。给定一幅肖像图像,首先在用户端提取其特定于图像的梯度,然后将其发布到隐私保护服务器云进行增强,得到对抗噪声。经过增强的对抗噪声的干扰后,得到的对抗肖像图像有望欺骗照片共享服务上潜在的人脸识别系统。整个过程中,原图仅供用户端访问,防止在服务器上泄露隐私。

核心解决方案是一个端云协同对抗攻击框架,由三个算法模块组成,分别部署在用户端和服务器云中:(1)Image-specific gradient generation,是通过可以在终端运行的压缩过的probe模型来获得图像梯度。(2)Adversarial gradient transfer,是将probe模型和服务器模型在云中的图像梯度进行对齐,以恢复对抗信息。(3)Universal adversarial perturbation,是附加与图像无关的通用扰动来进一步增强导出的对抗噪声。

3.3 Image-specific gradient generation

在用户端使用一个压缩模型,从原始图像中提取初步信息,然后在云中增强信息。在这个过程中可以使用多种对抗攻击方法,在这里我们只以FGSM为例。原始图像\(x\)的image-specific gradient \(g\)可以用以下公式提取:

其中,\(L(·)\)是衡量原始图像和注册图像特征距离的损失函数:

其中,\(d(·)\)是用欧几里得距离。

3.4 Adversarial gradient transfer

小的probe模型在用户端提取图像梯度来生成对抗样本。但是由于终端的probe模型和云服务器模型的结构和参数不同,不能直接使用梯度。为了对probe模型和服务器模型之间的图像梯度进行对齐,我们提出梯度迁移模块\(T\),其定义为:

我们认为梯度迁移模块是一个图像到图像的网络,我们使用U-Net架构将梯度从probe模型迁移到服务器模型。具体的,我们用以下优化问题来训练梯度迁移模型:

其中,\(\tilde{g}\)是用公式(1)在服务器模型上计算出来的梯度,\(\theta_T\)是网络\(T\)的参数。该目标函数使网络\(T\)学习probe模型和服务器模型之间的关系。

我们还设计了服务器为集成模型,将公式(4)中的\(\tilde{g}\)改为以下的\(\tilde{g}_{ensemble}\)即可:

其中\(\sum_{k=1}^{K}a_k=1\)。

3.5 Universal adversarial perturbation

通用对抗扰动包含了误导许多图像的分类的与image-independent的信息。这启发我们整合图像特定信息和图像无关信息来增强对抗扰动的性能

。